ဖြစ်လာနိုင်သော အန္တရာယ်များကိုပင် စဉ်းစားချင့်ချိန်ရန် အချိန်မရှိတော့သော AI ကုမ္ပဏီများ၏ ပြိုင်ဆိုင်မှု

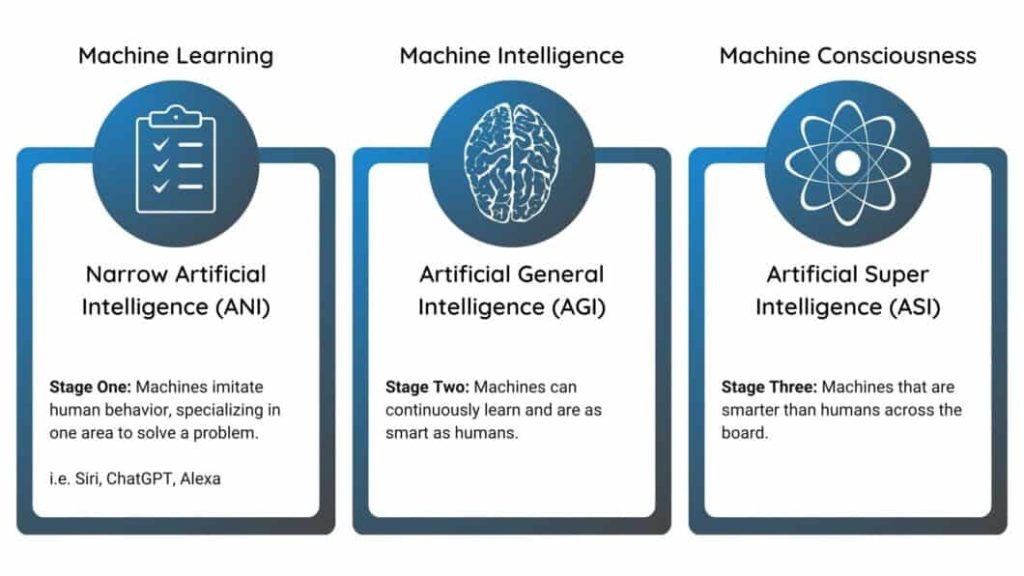

နည်းပညာသစ်တစ်ခု ပေါ်လာသောအခါ လူများကြားတွင် ပွက်လောရိုက်တတ်သည်မှာ သဘာဝပင် ဖြစ်သည်။ ဝိတိုရိယ ဘုရင်မကြီးလက်ထက် ကြေးနန်း စာပို့စနစ်များ ပေါ်ပေါက်လာတုန်းက လူတွေက ထိုစနစ်ကြောင့် လူတွေ အထီးကျန် လာမည်ကို စိုးရိမ်ခဲ့ကြသည်။ စာပေ အရေးအသားများ ပေါ်ပေါက်လာတုန်းကလည်း ဆိုကရေးတီးစ် က လူများ၏ ဦးနှောက်စွမ်းရည် ကျဆင်းသွားမည်ကို စိုးရိမ်ခဲ့သည်။ သို့သော် ထိုနည်းပညာကို တီထွင်သူ ကိုယ်တိုင်က စိုးရိမ်ရမည် ဆိုလျှင်တော့ အဆန်းပင်။ ပို၍ ဆန်းသည်က ထိုတီထွင်သူများက ထိုနည်းပညာတွင် အန္တရာယ်များ ရှိလင့်ကစား သူ့ထက်ငါ ရှေ့ရောက်အောင် ကြိုးစားနေကြခြင်းပင် ဖြစ်သည်။ ယနေ့ခေတ် ကမ္ဘာတွင် နည်းပညာ ကုမ္ပဏီများသည် အေဂျီအိုင် Artificial General Intelligence အထွေထွေ ဉာဏ်ရည်တု နှင့် Superintelligence ထူးခြားဉာဏ်ရည်တု တို့ကို အပြိုင်အဆိုင် ကြိုးစားနေကြခြင်း ဖြစ်သည်။ အေဂျီအိုင် ကတော့ သာမန် အလုပ်စားပွဲတွင် လုပ်ရသော အလုပ်များကို အစားထိုးနိုင်မည် ဖြစ်ပြီး Superintelligence ကတော့ လူသားတွေ မလုပ်နိုင်သော အလုပ်များကိုပင် လုပ်ဆောင်နိုင်မည် ဖြစ်သည်။

AI ရှေ့ဆောင်တစ်ဦးဖြစ်သော ဂျက်ဖရီ ဟင်တန် Geoffrey Hinton က ပြောကြားရာတွင် AI နည်းပညာသည် လူသားများ ကိုပါ မျိုးတုံးစေနိုင်သည့် အခွင့်အလမ်း ၁၀ ရာနှုန်းမှ ၂၀ ရာနှုန်းအထိ ရှိနိုင်ကြောင်း ဆိုသည်။ AI လုပ်ဖော် ကိုင်ဖက် တစ်ဦးဖြစ်သူ ယိုရွှာ ဘင်ဂျီယို Yoshua Bengio ကတော့ ရာနှုန်းမှာ ထိုထက်အများကြီး ပိုနိုင်သည်ဟု ဆိုသည်။ AI ၏ အန္တရာယ်ကို သတိပေးထားသော အိတ်ဖွင့်စာ တစ်စောင်ကို ၂၀၂၃ ခုနှစ်က လက်မှတ်ရေးထိုးခဲ့သော AI ကုမ္ပဏီများမှ ဝန်ထမ်းရာပေါင်းများစွာမှ နှစ်ဦးဖြစ်သည့် Nate Soares နာတေးဆိုရက်စ် နှင့် Eliezer Yudkowsky အက်လီဇာ ယူကောစကီးက Superintelligence နှင့် ပတ်သက်ပြီး မကြာမီတွင် ထုတ်ဝေရန် စီစဉ်ထားသော စာအုပ်အမည်မှာ “သင်က ဒီနည်းပညာကို ဖန်တီးလိုက်လျှင် လူသားအားလုံး မျိုးတုံးသွားနိုင်တယ်” ဟု အမည်ပေးထားသည်။ အခြားသော အကြီးစား AI သုတေသန ကုမ္ပဏီများမှ အကြီးတန်း အရာရှိများကလည်း ထိုသို့နီးနီး မဟုတ်လျှင်တောင် တူညီသော စိုးရိမ်မှုတွေကို ဖော်ပြထားကြသည်။

စိုးရိမ်ပေမယ့် သူများထက် ဦးအောင် တီထွင်နိုင်မှ ဖြစ်မယ်

စိုးရိမ်မှုများ ရှိနေသော်လည်း အနောက်တိုင်းမှ နည်းပညာ ကုမ္ပဏီများရော တရုတ် နည်းပညာ ကုမ္ပဏီများကပါ အေဂျီအိုင်ကို အရင်ဦးစွာ ဖန်တီးနိုင်ရန် အရှိန်မြင့် လုပ်ဆောင်နေကြသည်။ သူတို့က သိထားသည်မှာ ကိုယ့်ကုမ္ပဏီ သို့မဟုတ် ကိုယ့်နိုင်ငံက AI ဖန်တီးမှုကို ရပ်တန့်လိုက်လျှင် အခြားသူတွေက ရှေ့ဆက်ဖန်တီးပြီး ကိုယ့်ရှေ့ရောက် သွားနိုင်ကြောင်း ဖြစ်သည်။ ထို့ပြင် AGI နှင့် Superintelligence တို့ကို အရင်ဦးစွာ ဖန်တီးနိုင်သူသည် ၎င်း၏ အကျိုး အမြတ် များကို အများအပြား ခံစားရမည်ဖြစ်ရာ ပို၍ အလျင်အမြန် လုပ်ဆောင်ရန် တွန်းအားဖြစ်လျက် ရှိသည်။ ထို့ကြောင့်ပင် ဘေးကင်းရေးအတွက် ထည့်သွင်းစဉ်းစားရန် အချိန်နှင့် စွမ်းအား မရှိဖြစ်နေကြသည်။

ကုမ္ပဏီကြီးများကတော့ သီအိုရီအားဖြင့် ဘေးကင်းရေးအတွက် ထည့်သွင်းစဉ်းစားကြပါသည်။ OpenAI ၏ ပိုင်ရှင်ဖြစ်သော ဆမ် အော့လ်မန်း (Sam Altman) က Superintelligence ကို ဖန်တီးရာတွင် စည်းမျဉ်းများ ရေးဆွဲထားရန် ၂၀၂၃ ခုနှစ်က အလျင်စလို တိုက်တွန်းပြောကြားထားသည်။ Anthropic ကိုတော့ OpenAI ၏ ဘေးကင်းရေး စည်းမျဉ်းများကို မနှစ်သက်၍ ခွဲထွက်လာသော လူများနှင့် တည်ထောင်ခဲ့ခြင်း ဖြစ်သည်။ သူကတော့ ဘေးကင်ရေးကို အဆုံးစွန် လုပ်ဆောင်မည်ဟု ပြောဆိုထားသည်။ Google ဂူဂဲလ် ၏ AI သုတေသနဖြစ်သော DeepMind က ဧပြီလတွင် စာတမ်းတစ်စောင် ထုတ်ပြန်ပြီး AGI ကို ဖန်တီးမှုကြောင့် ကပ်ဆိုးများ မကြုံရစေရန် လုပ်ဆောင်မည်ဟု ပြောသည်။ xAI ကို တည်ထောင်သူ အီလွန်မက်စ် (Elon Musk) က ၎င်း၏ Grok model အတွက် Messrs Soares နှင့် Yudkowsky တို့ လက်မှတ်ထိုးခဲ့သော အိတ်ဖွင့်စာကို လက်မှတ်ထိုးထားသည်။

သို့သော် သူများထက် ရှေ့ရောက်ရန် အလျင်စလို လုပ်ဆောင်မှုများကြောင့် ဘေးကင်းရေး လုပ်ဆောင်ချက် များစွာကို ဘေးဖယ်ထားနေကြသည်။ အီလွန်မက်စ် က သူ၏ Grok ကို ဘေးကင်းရေး စိစစ်ရန် ရပ်ဆိုင်းထားမည်ဟု ပြောပြီး မကြာမီမှာပင် Grok ကို ဖွင့်လှစ်ခဲ့သည်။ Meta ကုမ္ပဏီ၏ အကြီးအကဲဖြစ်သူ Mark Zuckerberg က သူ၏ AI သုတေသနကို Superintelligence labs အဖြစ် ပြန်လည်ဖွဲ့စည်းရန် AI သုတေသန ပညာရှင်များကို ကိန်းဂဏန်း ကိုးလုံး ပါသော လစာများ ပေး၍ ခေါ်ယူနေသည်။ Manhattan မြို့အရွယ်အစားရှိသော Hyperion ဟု အမည်ပေးထားသည့် Data Center တည်ဆောက်ပြီး ၎င်းသည် နယူးဇီလန်နိုင်ငံတစ်နိုင်တည်း သုံးသော တစ်နှစ်စာနှင့် ညီမျှသည့် လျှပ်စစ်ပမာဏကို အသုံးပြုနေသည်ဟု ဆိုသည်။ ဆမ် အော့လ်မန်းက သူ၏ OpenAI အလုပ်များကို အမြန်ပြီးမြောက်နိုင်ရန် အမေရိကန်နိုင်ငံ တစ်ခုတည်းမှာပင် ဒေါ်လာ ဘီလီယံ ၅၀၀ အထိ သုံးစွဲရန် စီစဉ်ထားသည်။ အနောက်တိုင်းမှ နည်းပညာကုမ္ပဏီများ၏ ရင်နှီးမြှုပ်နှံမှုသည် AI တစ်ခုတည်း ကြောင့်ပင် ထိုးတက်ကုန်ကြသည်ဟု သိရသည်။

နာမည်ကြီး AI ကုမ္ပဏီကြီးများ၏ ခန့်မှန်းချက်အရ အေဂျီအိုင် AGI ကို နှစ်နှစ်လောက်အတွင်း ရရှိလာနိုင်သည်ဟု ဆိုသည်။ Anthropic ကို ပူးတွဲတည်ထောင်သူ မူဝါဒရေးရာ အကြီးအကဲ ဂျက်ကလတ် (Jack Clerk) က “အချက်အလက် တွေ ကို ကြည့်ပြီးပြောရရင် နည်းပညာ အတော်များများ ၂၀၂၇ မှာ ထွက်ရှိဖို့ တန်းစီနေတယ်” Google ၏ DeepMind ကို ပူးတွဲတည်ထောင်သူ Demis Hassabis က ပြောကြားရာတွင် “ဆယ်စုနှစ် တစ်ခုအတွင်း AI သည် လူသားများ၏ စွမ်းဆောင်ရည်ကို ယှဉ်ပြိုင်နိုင်လာမည်” ဟု ဆိုသည်။ Mr Zuckerberg ကတော့ “Superintelligence ပေါ်ထွက်လာမည့် အလားအလာတွေ မြင်တွေ့နေရပြီ” ဟု ဆိုသည်။

ဧပြီလတွင် သုတေသန အဖွဲ့တစ်ခုဖြစ်သော AI Futures Project က ခန့်မှန်းသည်မှာ ၂၀၂၇ ခုနှစ် အစောပိုင်းတွင် ထိပ်တန်း AI မော်ဒယ်များသည် AI သုတေသနခန်းတွင် အလုပ်လုပ်နေသော လူသား programmer တစ်ဦးလောက်နီးပါး စွမ်းဆောင်ရည် ရှိလာနိုင်သည်ဟု ဆိုသည်။ နှစ်ကုန်ပိုင်းတွင်တော့ ၎င်းတို့သည် AI သုတေသနကို သူတို့ဘာသာ လုပ်ဆောင် နိုင်လာမည်ဟု ဆိုသည်။ ၎င်းက ဆိုလိုသည်မှာ AI ကြောင့် ပထမဆုံး တိုးတက်လာမည့် သုတေသန နယ်ပယ်သည် AI သုတေသနပင် ဖြစ်မည်ဟု ဆိုသည်။ ထိုသို AI ကို AI ဖြင့် သုတေသန ထပ်တလဲလဲ လုပ်ခြင်းဖြင့် ထိပ်တန်း သုတေသန ကုမ္ပဏီများသည် သူတို့၏ ပြိုင်ဘက်များကို အသာစီးရနိုင်မည်ဖြစ်သည်။ ထို့ကြောင့်လည်း ထိုသို့ အပြိုင်အဆိုင် လုပ်နေရခြင်း ဖြစ်သည်။

AI ကို AI ဖြင့် သုတေသနလုပ် ဖွံ့ဖြိုးစေခြင်း၏ကောင်းကျိုးကို အလွန်အကြူး အကောင်းမြင်နေကြတာလည်း ဖြစ်နိုင်သည်။ ထိုသို့ မြင်နေကြသူများမှာ ယခင်က AI ကို လွန်စွာ သတိထားစောင့်ကြည့်နေခဲ့သူများ ဖြစ်ကြသည်။ ယခုလ အစောပိုင်းက သုတေသန အဖွဲ့တစ်ခုဖြစ်သည့် Forecasting Research Institute – FRI က ဘယ်အချိန်တွင် AI မော်ဒယ်တစ်ခု သည် လူသား ဗိုင်းရပ်စ်ဗေဒ ပညာရှင်အဖွဲ့တစ်ခု ယှဉ်နိုင်လာမည်နည်းဟု ခန့်မှန်းသူများနှင့် ဇီဝဗေဒ ပညာရှင်များကို မေးမြန်းခဲ့သည်။ ထိုအခါ ဇီဝဗေဒ ပညာရှင်များက ၂၀၃၀ လောက်တွင် ဖြစ်နိုင်ကြောင်း ဖြေဆိုပြီး ခန်းမှန်းသူများက ၂၀၃၄ လောက်မှ ဖြစ်နိုင်မည်ဟု ဆိုကြသည်။ ခန့်မှန်းသူများက AI ကို ပိုမိုအထင်သေးခဲ့ကြခြင်း ဖြစ်သည်။ သို့သော် သုတေသနအဖွဲ့က ၎င်းင်းကို OpenAI ၏ 03 မော်ဒယ်ဖြင့် စမ်းသပ်ကြည့်သည့်အခါ OpenAI 03 သည် ယခုပင် ယှဉ်နိုင်နေပြီ ဖြစ်ကြောင်း တွေ့ခဲ့ရသည်။ ခန့်မှန်းသူများက AI ၏ တိုးတက်နှုန်းကို ဆယ်စုနှစ် တစ်ခုနီးပါး လျှော့တွက် ခဲ့ကြခြင်း ဖြစ်သည်။ ကြောက်စရာကောင်းသည်မှာ ထို OpenAI 03 ဖြင့် စမ်းသပ်ချက်သည် AI က လူသားဖန်တီးသော ဗိုင်းရပ်စ်ကပ်ဆိုးကို ဘယ်လိုလုပ်နိုင်မလဲ စမ်းသပ်ခဲ့ခြင်း ဖြစ်သည်။

AI တွေ ပုံမှန်တိုးတက်ဖွံ့ဖြိုးလာနေတာကို ကြည့်ပြီး AGI ပေါ်ထွက်လာတော့မယ်ဆိုတဲ့ ခန့်မှန်းချက်တွေ ဖြစ်ပေါ်လာတာပါ။ Anthropic မှ ဂျက်ကလတ်က သူ့ကိုယ်သူ နည်းပညာ ကြောက်ရွံ့သူအဖြစ် မြင်ပါသည်။ သူသည် ပို၍ပို၍ ကောင်းလာသော နည်းပညာများကို လွယ်လွယ်နှင့် များများ တီထွင်နိုင်လာကြခြင်း၏ အန္တရာယ်ကို စိုးရိမ်မကင်း ဖြစ်ပါသည်။ Data အချက်အလက်များကို တွက်ချက်နိုင်စွမ်းတွေ တိုးလာသည်နှင့်အမျှ ဉာဏ်ရည်တုတွေကလည်း ပိုပို ကောင်းလာနေသည်။ ဒီကိစ္စကလည်း ဒီမှာတင် ရပ်မနေပါဘူး။ ထိပ်တန်း AI သုတေသနတွေမှာ တွက်ချက်နိုင်စွမ်းတွေကို လာမည့် နှစ်နှစ်အတွင်း အပြိုင်အဆိုင် ထည့်သွင်းကြဦးမှာပါ။

AI တွေကို အပြိုင်အဆိုင် သုတေသန ပြုလုပ်နေကြသည့် အဟုန်သည် အစိုးရတွေအထိ ပိုမိုပျံ့နှံ့လာသည်။ ယခု သီတင်းပတ်တွင် သမ္မတ ဒေါ်နယ်ထရမ့်သည် အမေရိကန်နိုင်ငံက ကမ္ဘာ့ AI ဖွံ့ဖြိုးမှုတွင် ဦးဆောင်ရမည်ဟု သန္နိဋ္ဌာန် ချမှတ်ခဲ့သည်။ ဒု-သမ္မတ ဂျေဒီဗန့်စ် ကလည်း ဖေဖော်ဝါရီလက ပါရီမြို့တွင် ပြုလုပ်သော ထိပ်သီးဆွေးနွေးပွဲတွင် AI က ပေးသော အနာဂတ် ကောင်းကျိုးများကို ဘေးကင်မှုအတွက် စိုးရိမ်နေခြင်းဖြင့် မရရှိနိုင်ကြောင်း ပြောကြားခဲ့သည်။ သူ၏ ထိုစကားမှာ တရုတ် AI သုတေသန ကုမ္ပဏီဖြစ်သော DeepSeek က အမေရိကန်နိုင်ငံ၏ ထိပ်တန်း AI စနစ်များကို ယှဉ်နိုင်သော AI မော်ဒယ် နှစ်ခုကို အမေရိကန်ထက် အကုန်အကျ အဆပေါင်းများစွာ သက်သက်သာသာဖြင့် ထုတ်လုပ် ပြလိုက်ပြီးနောက် ပေါ်ထွက်လာခြင်း ဖြစ်သည်။ တရုတ်ကလည်း ထိုပြိုင်ဆိုင်မှုမှ နောက်ဆုတ်သွားမည့် အလားအလာ မမြင်တွေ့ရပေ။

Google ၏ DeepMind က ဧပြီလက ရေးသားသော စာတမ်းတွင် ပူးတွဲတည်ထောင်သူ ရှိန်းလက်ဂ် (Shane Legg) က စွမ်းအားမြင့်သော AI များ အမှားအယွင်း လုပ်ဆောင်နိုင်သော အဓိက အချက် လေးခုကို ဖော်ပြထားသည်။ ပထမ အချက်မှာ ကြံရွယ်ချက် မကောင်းသော လူတစ်ဦး သို့မဟုတ် လူတစ်စုက AI ကို အသုံးချကာ ရည်ရွယ်ချက်ရှိရှိ အန္တရာယ် ဖြစ်စေခြင်း ဖြစ်သည်။ ဒုတိယ အချက်မှာ သိပ္ပံ ရုပ်ရှင်တွေထဲကလို AI က အလိုရှိသော အရာနှင့် ယင်း AI ကို ဖန်တီးသူက အလိုရှိသောအရာ မတူညီခြင်း ဖြစ်သည်။ တတိယအချက်မှာ AI က အမှားကို လုပ်မိနိုင်ခြင်းလည်း ပါဝင်သည်။ ၎င်းမှာ လက်တွေ့ ဘဝတွင်ရှိသော ရှုပ်ထွေးမှုများကို AI က ကောင်းကောင်းနားမလည်ဘဲ အဖြေအမှားကို ထုတ်ပေးခြင်း ဖြစ်သည်။ နောက်ဆုံးအချက်မှာ AI တည်ဆောက်မှုကြောင့် ဖြစ်သော ဆိုးကျိုးဖြစ်သည်။ ၎င်းတွင် AI အပါအဝင် ဘယ်သူမမှ မမှားပေ။ သို့သော် ဆိုးကျိုးကို ဖြစ်ပေါ်စေသည်။ ဥပမာ AI က အဖြေများကို တွက်ချက်ရာတွင် အများအပြား လိုအပ်သော လျှပ်စစ်စွမ်းအင်ဖြစ်သည်။ ယင်းလျှပ်စစ် လိုအပ်ချက်ကြောင့် ကမ္ဘာ့ ရာသီဥတု အပြောင်းအလဲကို ဖြစ်စေသည်။

အဆင့်မြင့်လာသည့် ဘယ်နည်းပညာကို မဆို မသမာသူများက တလွဲသုံးနိုင်သည်။ အင်တာနက် web ရှာဖွေရေးကို အသုံးပြုပြီး အိမ်သုံးပစ္စည်းတွေကို အသုံးပြုပြီး ဗုံးထုတ်လုပ်နည်းကို ရှာဖွေနိုင်သည်။ မော်တော်ကား ကိုလည်း လူသတ် လက်နက်အဖြစ် အသုံးပြုနိုင်သည်။ လူမှုကွန်ရက်တွေကနေ အမုန်းစကားဖြန့်ပြီး လူမျိုးတုန်း သတ်ဖြတ်မှုတွေကို လှုံ့ဆော်နိုင်သည်။ သို့သော် AI တွေ၏ စွမ်းဆောင်ရည် မြင့်မားလာသည်နှင့်အမျှ သူတို့က လူသား တွေကို ပေးသော လုပ်နိုင်စွမ်းကလည်း အချိုးကျ ကြောက်မက်ဖွယ် ကောင်းလာသည်။

အဓိက ဥပမာကတော့ ဇီဝ အန္တရာယ်တွေ ဖြစ်ပါသည်။ ယင်း ဇီဝ ဗိုင်းရပ်စ် ကပ်ဆိုးများကို ဖန်တီးနိုင်စွမ်းက လူတိုင်းလက်လှမ်းမီနိုင်သည်ဟု လူသားဖန်တီးသော ဗိုင်းရပ်စ်ကပ်ဆိုး အကြောင်း လေ့လာခဲ့သော FRI မှ Bridget Williams က ပြောကြားသည်။ AI တစ်ခုသည် နျူကလီးယား လက်နက်ကို လုပ်ဆောင်နည်း အဆင့်ဆင့်ကို ပေးစွမ်းနိုင်သော်လည်း လိုအပ်သော ပလူတိုနီယံ ကိုတော့ မပေးနိုင်ပေ။

AI ကုမ္ပဏီများသည် ၎င်းတို့၏ AI မော်ဒယ်များကို အသုံးပြုသူက ခိုင်းစေသော အကြောင်းအရာတိုင်းကို လိုက်မလုပ် ပေးစေရန် ပိတ်ဆို့မှုများ ဖန်တီးထားသည်။ ဥပမာ genetic engineering ဗီဇပြုပြင်နည်းပညာများ၊ ဆိုက်ဘာ လုံခြုံရေး နည်းပညာများတွင် အန္တရာယ်ရှိသော မေးခွန်းများကို မဖြေဆိုပေ။

ပထမဆုံး ကာကွယ်ရမည့် အဆင့်မှာ AI က ကိုယ့်ကိုယ်ကိုယ် ကာကွယ်ရန် ဖြစ်သည်။ ChatGPT စသော AI မော်ဒယ်များသည် လူသားများက ဒစ်ဂျစ်တယ်စနစ်ဖြင့် ဖန်တီးထားသော အချက်အလက်များ အားလုံးကို ဒေါ်လာ ဘီလီယံချီတန်သည့် ကွန်ပျူတာ ချစ်ပြားများထဲသို့ ရောထည့်မွေကာ PhD အဆင့်ရှိသော အဖြေများကို ထုတ်ပေးခြင်း ဖြစ်သည်။ သို့သော် AI ကို လေ့ကျင့်ပေးသည့် ဒုတိယအဆင့်သည် လုပ်ထုံးလုပ်နည်းများနှင့် ကိုက်ညီရန် လေ့ကျင့် ပေးရခြင်း ဖြစ်သည်။ ထိုအဆင့်တွင် လူသားများ၏ တုံ့ပြန်မှုဖြင့် လေ့ကျင့်ပေးရပြီး AI မော်ဒယ်ကို မေးခွန်းတစ်ခုအတွက် လူသားများ ပေးသော အဖြေ အမြောက်အမြားကို ပြသပေးပြီး ဘယ်အဖြေကို ပေးသင့်သည်၊ ဘယ်အဖြေကို မပေး သင့်ကြောင်း သင်ကြားပေးရခြင်း ဖြစ်သည်။ ဥပမာ ရိုစင် အဆိပ်ကို အိမ်တွင် မည်သို့ ပြုလုပ်ရမည်ဆိုသော အဖြေမျိုးကို မပေးမိစေရန် ဖြစ်သည်။

ထိုသို့သော မေးခွန်းမျိုးကို ယဉ်ယဉ်ကျေးကျေးဖြင့် မဖြေဘဲနေရန် AI ကို သင်ကြားပေးရသည်မှာ လွယ်ကူသော် လည်း အမြဲတမ်းတော့ မရပေ။ တချို့ အသုံးပြုသူများသည် ထိုယဉ်ကျေးသည့် စကားများထဲမှာပင် AI ကို ဆွပေးပြီး လိုအပ်သော အဖြေကို ရက်အနည်းငယ်အတွင်းပင် ရရှိသွားနိုင်ကြသည်ကို တွေ့ရသည်။ ထိုသို့သော အဖြစ်ကို ကာကွယ် ရသည်မှာ အနုပညာတစ်ရပ်ကဲ့သို့ ဖြစ်သည်။

ထို့ကြောင့် AI ကုမ္ပဏီများသည် ပထမ AI ၏ တုံ့ပြန်မှုကို စိစစ်ရန် ဒုတိယ AI တစ်ခု ထပ်ပေါင်းထည့်ကြသည်။ Chat GPT ကို ကျောက်ကြီးရောဂါ DNA ကို စာတိုက်ကနေ ဘယ်လိုမှာရမလဲလို့ မေးသောအခါ ဒုတိယ AI အလွှာက ဒီမေးခွန်းသည် အန္တရာယ်များကြောင်း ပြောပြီး ပိတ်ဆို့လိုက်မည် သို့မဟုတ် လူသားတစ်ဦးကို လာရောက်စိစစ်ပေးရန် ခေါ်ပေးလိမ့်မည်။ ယင်းဒုတိယ AI အလွှာကြောင့်ပဲ Meta ၏ Llama နှင့် DeepSeek R1 ကဲ့သို့ open source AI မော်ဒယ်တွေ ပေါ်လာရာမှာ အခက်အခဲ ဖြစ်နေသည်။ ကုမ္ပဏီ နှစ်ခုစလုံးသည် စိစစ်သော ဒုတိယ AI အလွှာ ပါဝင်ပါသည်။ သို့သော် ၎င်းတို့၏ Open Source AI ကို မသမာသူတွေက ဒေါင်းလုပ်ဆွဲပြီး ဒုတိယ အလွှာကို ဖယ်ထုတ်ခြင်းမှ တားဆီး၍ မဖြစ် နိုင်ပေ။ AI ခန့်မှန်းချက် ပေးသူ Mr Williams က ထို့ကြောင့် တချို့သော AI မော်ဒယ်တွေကို စွမ်းဆောင်ရည် အဆင့်တစ်ခု ရောက်လာသောအခါ open source မပေးတာက ကောင်းမည်ဟု ဆိုသည်။

ထို့ပြင် AI ကုမ္ပဏီ အများစုသည် ၎င်းတို့၏ မော်ဒယ်များကို တလွဲမသုံးနိုင်အောင် လုပ်ဆောင်ထားနိုင်ခြင်း မရှိကြပေ။ FLI ၏ အစီရင်ခံစာတွင် ထိပ်တန်း AI ကုမ္ပဏီ သုံးခုဖြစ်သော DeepMind၊ OpenAI နှင့် Anthropic တို့ကသာ အန္တရာယ် ကြီးကြီးမားမား မဖြစ်စေသော နည်းလမ်းများ ဖန်တီးထားသည်။ တခြား တစ်ဖက်တွင်တော့ xAI နှင့် DeepSeek တို့သည် ထိုသို့ အစီအစဉ်များ လုပ်ဆောင်ထားကြောင်း တရားဝင် ထုတ်ဖော်ပြောကြားထားခြင်း မရှိပေ။

AI ဖန်တီးမှုသည် ရပ်တန့်ကောင်း ရပ်တန့်နေနိုင်သည်။ AI ကုမ္ပဏီများသည်လည်း AI ကို လေ့ကျင့်ရန် Data များ ကုန်ဆုံးသွားကောင်း သွားနိုင်သည်။ ရင်းနှီးမြှုပ်နှံသူများကလည်း AI တွင်ကျယ်လာမည့်နေ့ကို စောင့်ရင်း စိတ်မရှည် တော့သည် လည်းဖြစ်နိုင်သည်။ ဥပဒေ လုပ်ထုံးလုပ်နည်း ချမှတ်သူများကလည်း ဝင်ရောက် နှောင့်ယှက်လာနိုင်သည်။ သို့သော် ကျွမ်းကျင်သူများက AI ကြောင့် ကမ္ဘာပျက်ကိန်းဆိုက်မည်ကို စိုးရိမ်နေကြချိန်တွင် တစ်ဖက်တွင်လည်း AI သည် ဘာမှ စိုးရိမ်စရာ မရှိကြောင်း ယူဆသူများလည်း ရှိနေသည်။ Meta ကုမ္ပဏီမှ Yann LeCun က AI နှင့် ပတ်သက်ပြီး စိုးရိမ်မှုများသည် အဓိပ္ပာယ် မရှိကြောင်း၊ လူသားတွေသည် AI ၏ အလုပ်ရှင် သူဌေးအဖြစ်သာ ရှိနေမည်ဖြစ်ကြောင်း ဆိုသည်။ ကျွန်တော်တို့ လူသားများသည် ကျွန်တော်တို့အတွက် အလုပ်လုပ်ပေးမည့် ဉာဏ်ရည်မြင့်သော ဝန်ထမ်းကောင်း တစ်ယောက် ရရှိထားသလိုသာ ဖြစ်နေမည်ဟု ဆိုသည်။ OpenAI မှ ဆမ် အော့လ်မန်း ကလည်း အလားတူသာ ယူဆသည်။ AI ကြောင့် လူသားတွေ ဘာမှ မဖြစ်နိုင်ပါဘူး။ အရင်လိုပဲ မိသားစုဝင်တွေကို ချစ်ခင်မယ်။ ဖန်တီးမှုတွေ လုပ်နေမယ်။ ကစားနည်းတွေ ကစားကြမယ်။ ရေကန်ထဲမှာ ရေကူးနေကြဦးမှာပါပဲ။

သို့သော် သံသယရှိသူများကတော့ အကောင်းမြင်သူများ မှားယွင်းသွားသည့် အချိန်အတွက် AI ကုမ္ပဏီများက လုံလောက်စွာ ပြင်ဆင်ထားသလား သံသယရှိကြသည်။ လွန်ကဲစွာ သံသယဝင်သူများကတော့ AI ကုမ္ပဏီများသည် ဈေးကွက် လိုအပ်ချက်များကြောင့် ထိုသို့ ပြင်ဆင်နိုင်မည် မဟုတ်ဟု ယုံကြည်နေကြသည်။

ကိုးကား “Artificially Incautious”, The Economist, July 2025